Nuevo algoritmo ‘bajo el cofre’ de la IA permite dirigir sus respuestas

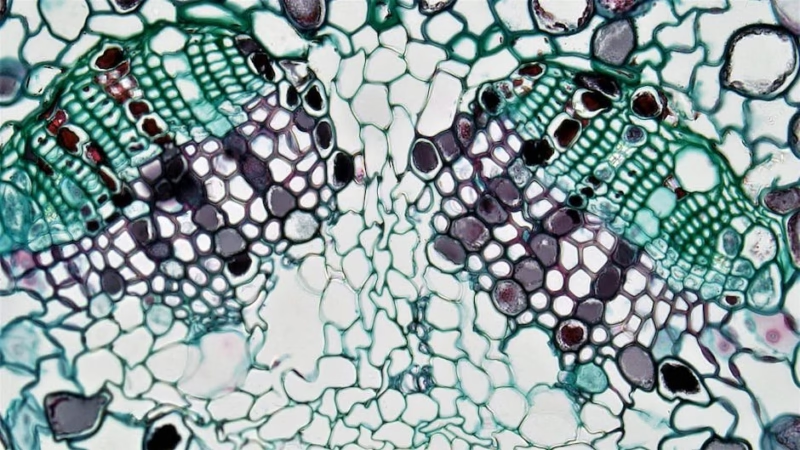

¿Es posible saber si la respuesta de un modelo de inteligencia artificial es correcta sin que un humano la revise? Las redes neuronales, base de muchos sistemas de IA, pueden codificar conceptos como la veracidad. Sin embargo, identificar estos patrones y usarlos para dirigir el comportamiento de los modelos es un desafío importante.

Un enfoque innovador

En un artículo publicado en Science, Beaglehole y sus colegas presentan un enfoque para dirigir la IA que supera a otros métodos en una tarea de codificación. La técnica permite controlar y monitorear modelos de IA desde su interior, accediendo a los patrones numéricos que representan conceptos como la verdad.

¿Cómo funciona?

El algoritmo identifica representaciones internas de conceptos dentro de la red neuronal y las utiliza para ajustar las respuestas del modelo. Esto permite, por ejemplo, que un asistente de IA sea más preciso al responder preguntas fácticas sin necesidad de verificación externa.

Implicaciones futuras

Este avance podría mejorar la confiabilidad de los sistemas de IA en áreas como la medicina, la educación y la atención al cliente, donde la precisión es crucial. Además, ofrece una nueva forma de entender el funcionamiento interno de las redes neuronales, acercándonos a una IA más transparente.